本メモは9/5の日本心理学会での話題提供用に準備したものです。

今、科学や研究活動に携わる人々にとって、AIの存在感はかつてないほど増しています。あるAI企業のリーダーは「21世紀の科学はAIによって10倍のスピードに加速する」と語る一方で、「AIが科学をむしろ減速させかねない」といったリスクを指摘する声も少なくありません。AIによって科学はどう変わるのか。あるいは、私たちはAIを科学にどのように取り入れていけばよいのか。科学は多くの人々に影響する活動であることを思えば、科学者やAI研究者といった当事者を超えた、多くの人々の関心事となりうるトピックと言ってよいでしょう。

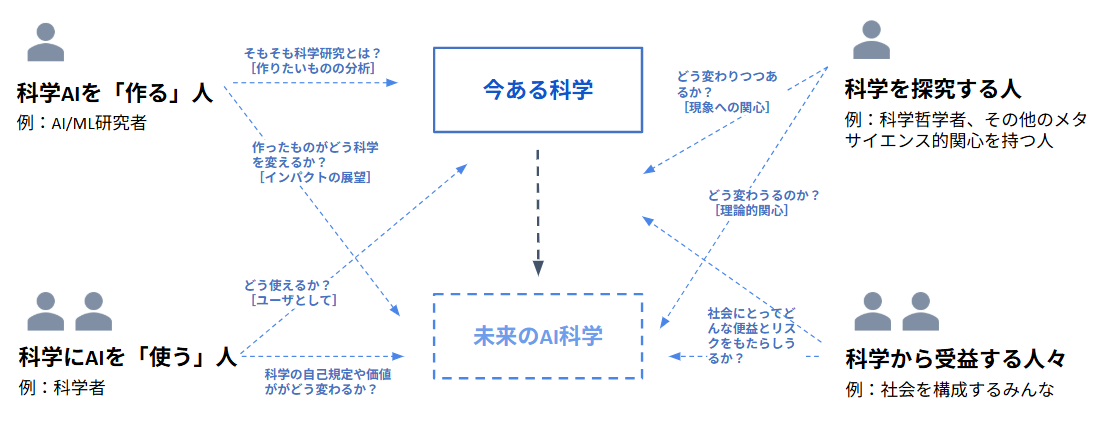

AI科学に対する様々な関心

科学におけるAI応用は、「AI for Science」あるいは「AI in Science」として議論されるようになっています。本稿では、このテーマに含まれる多くの論点を俯瞰することを目指し、以下の3つの話をしたいと思います。

- AI in/for Scienceにはいろいろある

- AI in/for Scienceは科学政策のNext big thingである

- AI in/for Scienceの光と闇

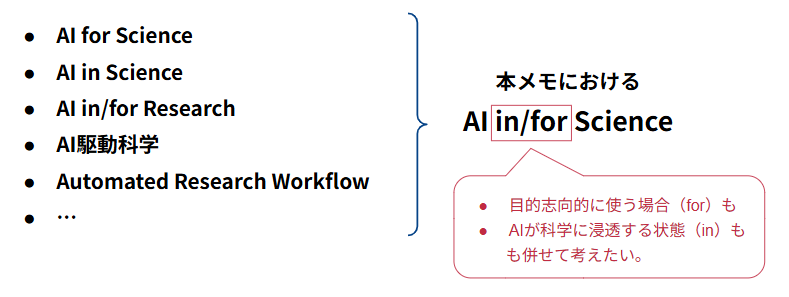

※補足「AI in/for Science」という表記について:なお、「AI for Science」は主に米国で2010年代後半に使われるようになったタームであり、一方で欧州の政策文書では「AI in Science」という用語が採用されているようです。前者にはより積極的にAIを科学の「ために」使っていこうという目的志向性が、後者はよりニュートラルにAIが科学に浸透している「状況」を記述しているニュアンスがありそうです。本稿では、「AI for Science」という用語にもある種のスタンスがにじんでいる可能性を踏まえ、「AI in/for Science」という表記を採用することにしました。なお、その他「AI in/for Research」「AI駆動科学」「Automated Research Workflow」などの言い方もありますが、本メモのスコープにはこれらもすべて含まれるとします。

1.AI in/for Scienceにはいろいろある

最初のセクションでは、「AI in/for Scienceにはいろいろある」という話をします。

ただし、ひとくちに「科学におけるAI利用」といっても、さまざまなものがごたまぜに語られがちです。実際には、以下のように非常に幅広いユースケースが含まれます。

- 論文検索に生成AIを搭載したシステム(Elicit、Consensusなど)を使う

- 実験データの分類に、機械学習ベースの識別器を使う

- 定理証明支援系を活用して数学の定理を証明する

- 分子生物学の実験室を自動化する(ラボラトリー・オートメーション)

- 計算機科学の論文を、アイディア着想から執筆まで end-to-end でAIに書かせる

- 書いた論文の英訳にDeepLを使う

- 査読対応をChatGPTに相談しながら進める

- 創薬研究にAlphaFold3を用いる

- 研究グラント審査のスクリーニングにLLMを利用する

- 研究アウトリーチのためにNotebookLMでブログやポッドキャストを作る

このように、科学におけるAI利用はきわめて多岐にわたります。ポテンシャルもリスクも、また議論すべき論点も、ユースケースによって大きく異なる。したがって、ある種の「地図」が整備されることが望ましいと考えられます。

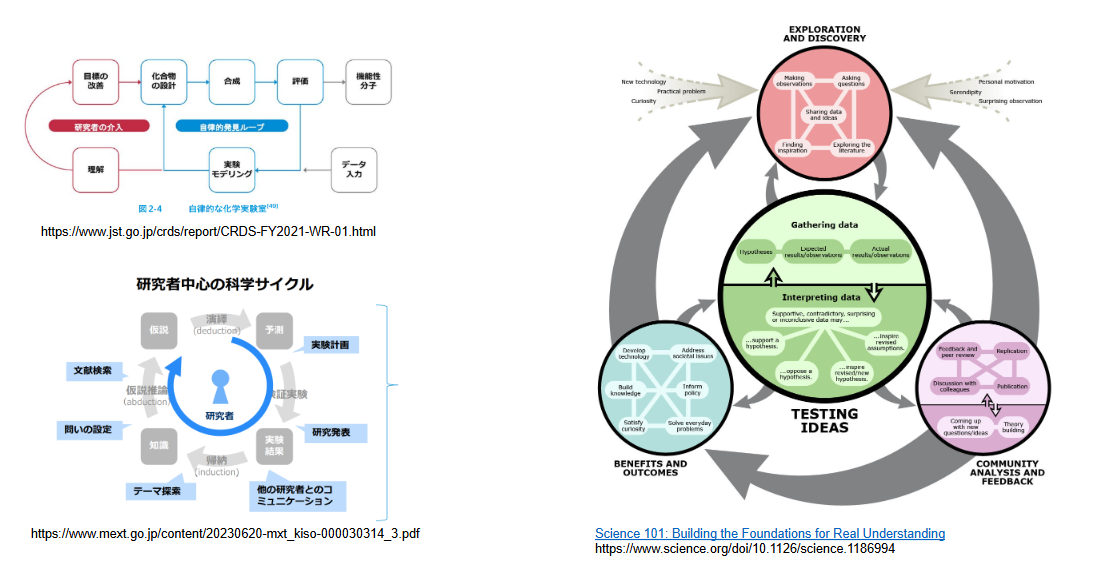

先行サーベイによる整理と、本稿の方針

では、既存のサーベイではどのような整理が行われているでしょうか。主だったものとして以下の3点を取り上げます。

- JST-CRDS (2021) 人工知能と科学 〜AI・データ駆動科学による発見と理解〜|戦略提案・報告書:日本の研究開発政策におけるAI×科学の方向性をまとめた戦略提案。深層学習やロボティクスを背景に「研究プロセスの変革(リサーチ・トランスフォーメーション)」を強調。仮説生成から検証・公開までのサイクルを、(1)網羅的仮説生成、(2)高速検証、(3)人間中心の統合的研究サイクルの三本柱で描く。

- [2507.01903] AI4Research: A Survey of Artificial Intelligence for Scientific Research:研究活動におけるAI応用を広く整理したサーベイ。研究プロセスを1)Scientific Comprehension(文献・表や図の理解)、2) Academic Survey(体系的レビュー生成)、3)Scientific Discovery(アイデア抽出→新規性評価→理論分析→実験設計〜実施〜解析)、4)Academic Writing、5)Peer Reviewingの五つに分けている。

- [2508.14111] From AI for Science to Agentic Science: A Survey on Autonomous Scientific Discovery:AIを科学の自律的主体とみなす方向性に焦点を当てたサーベイである。AIの進化段階や必要能力、研究プロセスを自動的に循環させる枠組みが提示されており、AIを「道具」から「パートナー/主体」へと位置づけ直している。

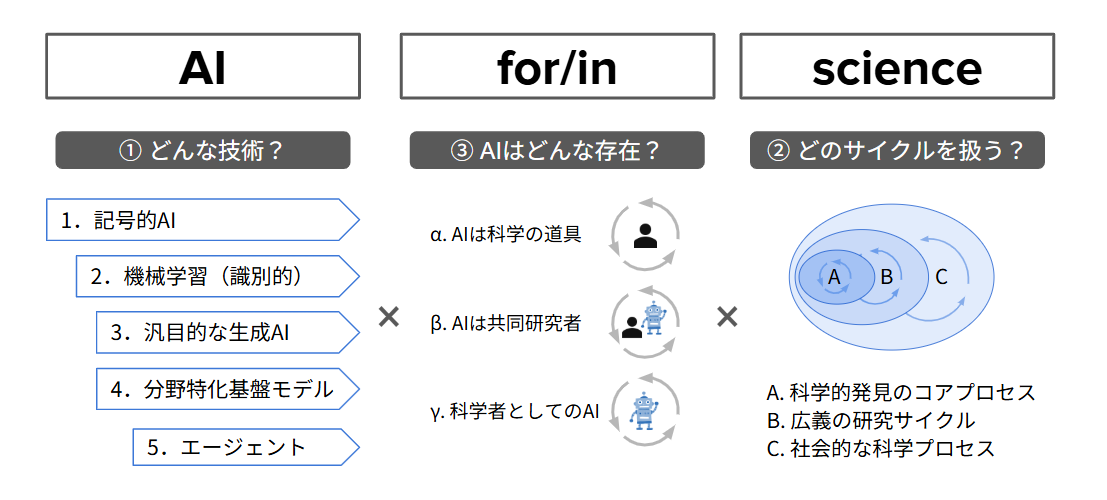

いずれも、科学のプロセスを広範に俯瞰し「どの部分にAIが使えるのか」を列挙しています。3つめのレビュー論文はとりわけ、今後のAIの発展段階を見越した整理に主眼を当てています。本メモでは、これらを参照しつつも、より包括的に、取りこぼしの少ない視点を持つために、次の3つの軸で整理を試みます。

- 「AI」という言葉で表現される技術

- 「科学/研究」のどの部分を扱っているのか

- AIと科学者の関係性

これはそれぞれ「AI」「Science」「for/in」に対応します。

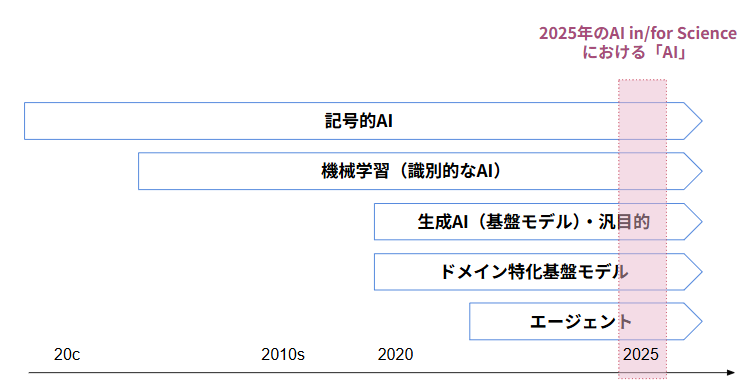

①「AI」という言葉で表現されている技術の多様性

AI for Scienceにおける「AI」という言葉で表現される技術には多様なものがあります。そもそも、AIという言葉が時代によって意味を変えてきた(AIがある機能を実現するとそれは「AI」とは呼ばれなくなる「AI効果」はすでに1970年代から指摘されていた)ことを踏まえる必要があります。機械学習ベースのAIではなく、記号的AI(古典的AI)を科学に使おうという試みは20世紀半ばから行われてきました(例:1960年代の、有機化学者の意思決定プロセスを模倣して未知の有機化合物の自動発見を目指す DENDRAL、1970 年代の、データから経験的法則を記述する数式を自動的に発見する BACONなど)が挙げられます。

20世紀終盤からは機械学習(ML)ベースのシステムの科学利用が増え、2000 年代になると、材料科学のマテリアルズ・インフォマティクス、生命科学のバイオインフォマティクスなどのデータ駆動型の科学研究がブームになりました。2010年代以降は、AlphaFold に代表されるように、これまで人間が解けなかった重要な科学的課題を解決する事例も生まれました。その他、Physics-Informed ML(物理法則や物理学的な事前知識を組み込んだ機械学習)、Sci ML(従来の科学計算と機械学習の融合)、Geometric Deep Learning(対象の幾何学構造に着目した深層学習)など、科学データを扱うための機械学習の基礎研究も大きく進展しています(参考:高木・丸山記事)。

そして、2020年代には、生成AIがブームとなり、科学研究に限らず一般に使われるツールとしての大規模言語モデルを研究者も日常的に使うようになりました。その一方で、基盤モデルに科学のデータを事前学習・事後学習等で学習させる「科学基盤モデル」の事例も出てきています。さらに、単に一問一答形式の基盤モデルではなく、科学を行う「AIエージェント」を構築する試みも出てきています。

こうした、「科学に用いられるAI技術」の多様性は、たとえば以下のように分類できるのではないかと考えます。

- 記号的AI/機械学習(識別的なAI)/汎目的な生成AI(基盤モデル)/ドメイン特化な基盤モデル/エージェント

さらに、科学に限らない汎用途AI/科学に特化したAI/科学の特定ドメインに特化したAIなのかという細分化した考察もできるかもしれません。

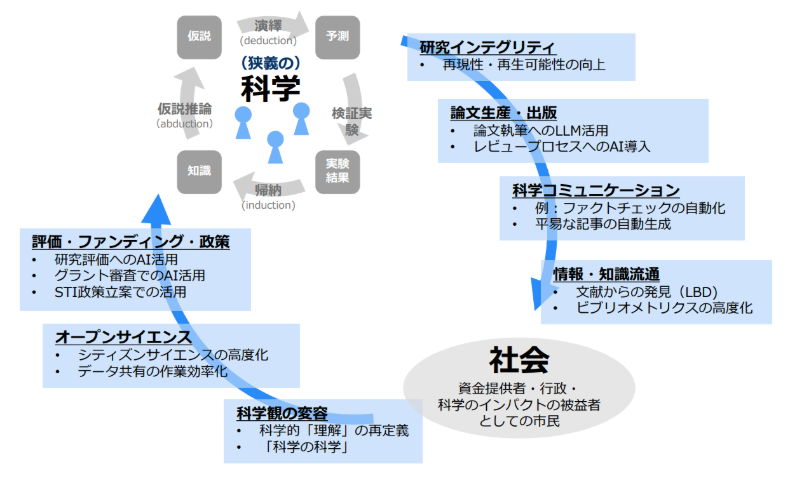

②「科学/研究」のどの部分を扱っているのか

二つ目は、「科学」ないし「研究」という営みのどのプロセスをAIで行うのか、に着目するものです。研究のプロセスは様々に記述されます。一例を挙げれば、「問いを立てる」→「仮説を作る」→「検証する」→「論文にまとめて公開する」などです。この前後にも多くのプロセスが介在しますし、各プロセスもより細かくブレイクダウンすることができます。

研究プロセスは様々に分解できる

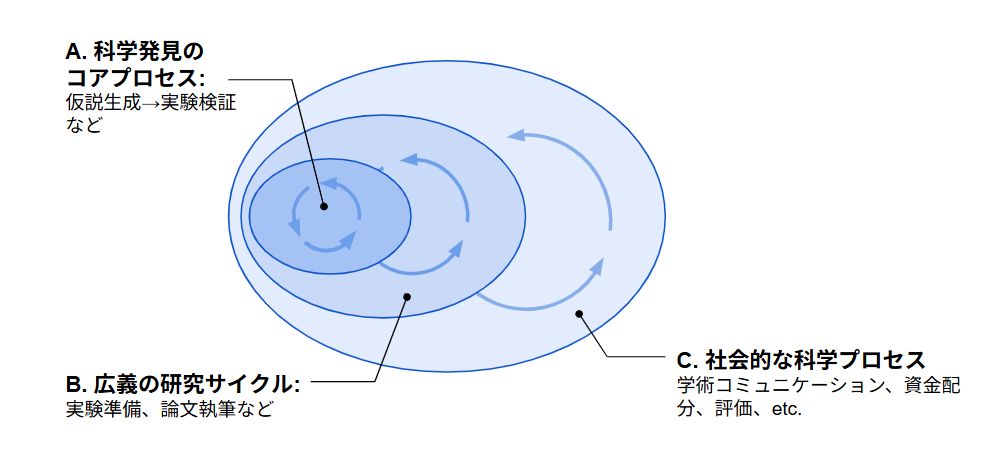

ここでは大雑把に、3つくらいのスコープに分けるのが良いのではないかと考えます。

- A. 科学的発見のコアプロセス:研究者が新しい科学的発見をするために行う中核的なプロセス。何が中核かは難しいところだが、先行研究を読んで、アイディアを思いつき、それを実験で確かめる、といった部分は入ると考えます。(※科学哲学では発見と正当化の文脈を分けるのが一般的ですが、ここでの意味での「発見」には正当化の一部も含むかも。)

- B. コアプロセス以外の広義の研究サイクル:研究者個人が研究として行うことのすべて。たとえば、実験装置を調達する、装置を調整する、共同研究者を見つける、論文を書くなど。

- C. 社会的な科学プロセス:科学は研究者個人が行うことだけでなく、研究者を含む集団的な営みであり、これには、論文の査読や掲載を含む学術コミュニケーション、研究者の評価、科学コミュニケーション、科学技術政策などが含まれます。

これらは、大きさの異なる3つのサイクルを成しています。

C. はAI for Scienceの普通の議論には含まれないことが多いですが、個人的には「AIが科学をどう変えるか」というときには重要な視点だと考えています。科学研究の成果がどのように流通し、評価され、資源配分されるか、という科学のシステム面での変化は、研究者個人が「AIを使うか否か」にかかわらず研究コミュニティ全員の実践に影響するからです(筆者は(3)を含むアジェンダ群を「AI科学のメタサイエンス」と呼びたいと思っています)。

社会的な科学プロセスへのAIの影響の例 出典:https://www.mext.go.jp/content/20230620-mxt_kiso-000030314_3.pdf

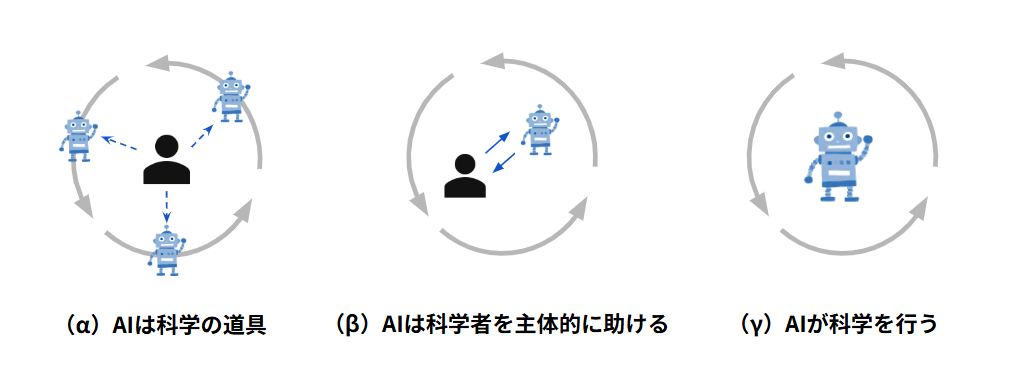

③ AIと科学者の関係性

最後が、「AIが科学の中でどのような役割を担うと想定されているか」に関する立場の違いです。これは、以下の3つに便宜的に分類してみたいと思います。

- (α)AIは科学の道具である

- (β)AIは科学者を主体的に助ける存在(≒共同研究者)である

- (γ)AIは科学を行う主体となる

1は、高度なコンピューターとしてAIを活用する態度です。3は、AIを自律的な研究者としてみなす方向性の態度であり、「AI Scientist」や「Agentic Science」と呼ばれるようなものが相当するでしょう。2は、AIに単なるコンピュータを超えた自律性/エージェンシーを持たせながら、あくまで人間の補助をさせるいわば「AI co-scientist」(e.g. Google)の方向性です。この3つの態度の違いは、②で述べた3重の科学サイクルのなかで、どれくらい「human-in-the-loop」を残すか、という思想の違いに帰結します。

3つの軸のまとめ

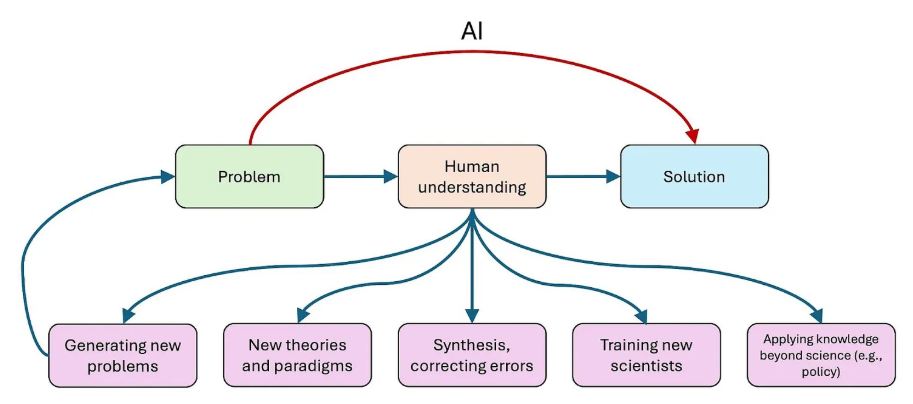

①~③の軸をまとめると、AI for/in Scienceの論点の多様性は以下の図のように整理できると考えます。

この図を用いれば、例えば

- 「論文の検索に生成AIを使う」は、「汎用途生成AI(3)」×「科学の道具(α)」×「広義の研究サイクル(A、B)」

- 「計算機科学の論文を、アイディアの着想から論文執筆までend-to-endでAIに書かせる」は「AgenticなAI(5)」×「科学の主体(γ)」×「広義の研究サイクル(A、B)」

のように分類することができます。それぞれ、可能性もリスクを含め考えるべき論点は大きく違うでしょう。AIの科学応用における個別論点は、少なくとも①、②、③の軸で上記くらいの解像度で分離しないと、意味のない議論になりにくいのではないか、というのが本メモのここまでの主張です。

集団レベルの科学プロセスをAI化するとは?

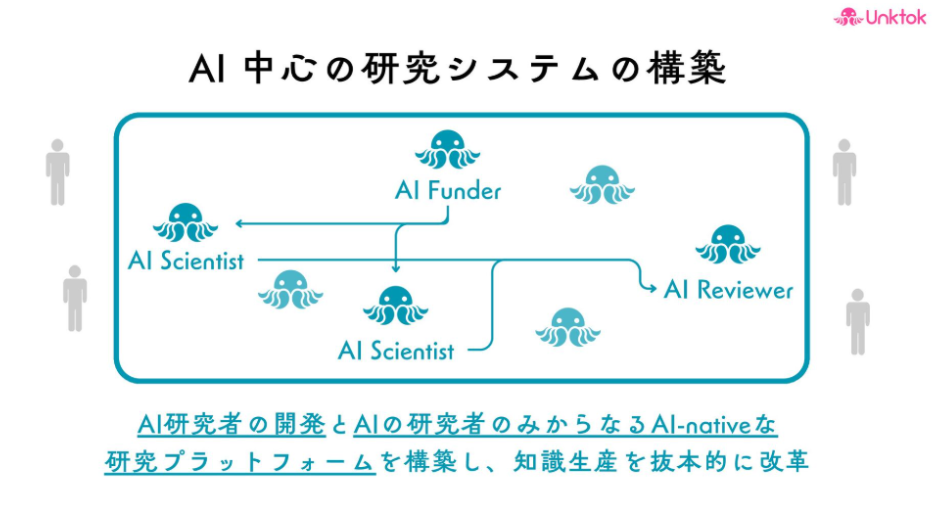

このなかでAIが「科学の主体」(γ)として想定されていながら、「集団レベルの科学プロセス」(C)を考えるというのは想像しにくいかもしれません。しかし、たとえば独立研究者の高木志郎氏は、研究者を代替するAIではなく、科学という営みそのものをAI化する「AI中心の研究システムの構築」というビジョンを描いています。

高木さん資料 https://speakerdeck.com/t46/aiqu-dong-aiyan-jiu-nixiang-kete

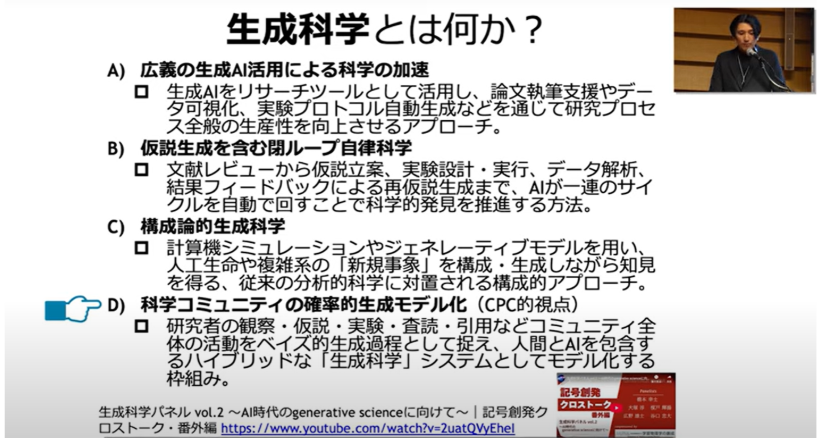

さらに、京都大学の谷口忠大氏らは、 集団レベルの科学プロセスそのものを一つの確率的生成モデルによってモデル化することによる、Cのレベルの科学の理論モデルを構築しようとしています。このアプローチを含む用語として、生成科学(generative science)を提唱しています。

谷口氏講演動画: 【AI for Science③】生成科学からの道

2. AI in/for Scienceは科学政策のNext big thingである

先述したように、AIの科学への応用は決して新しい話題ではなく、数十年にわたる歴史を持っています。しかし、2020年代前半の生成AIブームを経て、「AI in/for Science」は各国の科学政策のなかで急速に大きな位置づけを占めるようになりました。

各国政策はAI in/for Scienceを重視

米国では、ASAP(American Science Acceleration Project)なる構想が2025年6月に超党派の議員により示されました。これは2030年までに米国の科学革新のペースを「10倍」に加速する構想です。法制化前ですが、学術・産業の70超組織が支持を表明しています。AIを含む新インフラ・人材・規制改革を束ね、AI時代の研究速度の底上げを狙う提案です。

また、NAIRR(National AI Research Resource)は、研究者がAI研究およびAIを用いた科学研究に必要な計算資源・データ・ソフトウェア・基盤モデル・トレーニングへのアクセスを民主化する国家的な研究インフラ整備の構想です。2023年1月のタスクフォース最終報告は実装ロードマップを提示し、2024年1月にNAIRRパイロットがNSF主導で始動しました。NAIRRの重要な応用先の一つとして科学研究があります。

それ以前にも、たとえば2022年に全米アカデミーズがAutomated Research Workflowに関する包括的な報告書を出し、研究の自動化を各分野で推進するための提言を行っています。なお、米国ではエネルギー省(DOE)が2020年の報告書で「AI for Science」という言葉を用いており、政策の中でこの用語が見られる最初期の用例とされています。

EUでは、欧州委員会が2023年12月、「AI in Science」の政策必要性を訴える58頁のポリシーブリーフを公表しました。ここでは、科学におけるAI活用を戦略的課題と位置づけ、データ・計算能力・人材へのアクセス改善、AI利用の倫理的ガイドライン整備、影響の継続的モニタリングの必要性を示しています。その後、2025年6月5日までのパブリックコメントを経て、「European Strategy for AI in Science」の策定が最終段階に入り、2025年後半に正式発表が予定されています。さらに、生成AIの研究利用に関しては2025年4月に “Living guidelines on the responsible use of generative AI in research” を公表し、研究者が日常的にAIを活用する際の具体的な指針を示しています。

2024年5月、英国ロイヤルソサイエティは「AI時代の科学」と題する108ページのレポートを公開しました。各分野でのAI導入状況、歴史事例分析、特許分析などを踏まえ、①AIインフラ・ツールへのアクセス整備、②AIによる科学的アウトプットの信頼構築、③研究における安全・倫理的なAI利用を提言しています。

日本では、先述のようにJST-CRDSが2021年に戦略提言「人工知能と科学 〜AI・データ駆動科学による発見と理解〜」を公開しています。また、日本学術会議は、2021年12月に公開した回答文書「研究DXの推進-特にオープンサイエンス、データ利活用推進の視点から-に関する審議について」において、各分野のデータ駆動型科学の先進的実践を収集したうえで、日本のデータ駆動化を加速するための要件を提言しています。2026年からの5か年の科学政策を方向付ける「第7期科学技術・イノベーション基本計画」でも大きな柱になることが目されており(例:文科省「第7期科学技術・イノベーション基本計画に向けた検討状況等について」)、位置づけが強化されつつあります。

こうした各国政策や学術界からの発信には、AIで科学が大きく変わるなら、それについていかなければならないという危機感が見て取れます。あるいは、研究やイノベーションに関する国際競争で劣勢に置かれた国による、「AIで一発巻き返しが狙えるのではないか」という発想も現れているものと思われます。

実質的にAI in/for Scienceを牽引するのは民間企業

一方で、AI科学の最前線を牽引しているのは国ではなく、むしろ民間企業です。とりわけGoogle DeepMindは象徴的な存在です。タンパク質構造解析のAI「AlphaFold 2」は、2024年のノーベル化学賞にもつながりました。

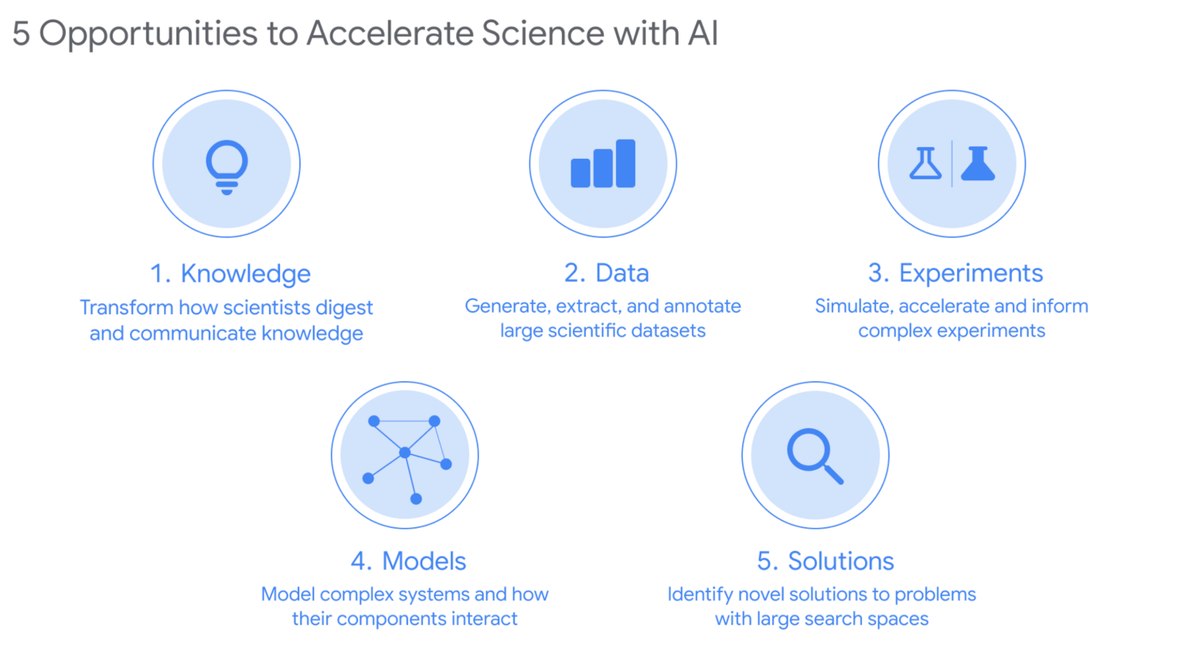

2023年、Googleは「A New Golden Age of Discovery」と題するレポートを公表し、そこでは科学的発見におけるAIの役割が次の5点に整理されています。

- Knowledge: 論文などの知識を理解・要約・再構成し、科学的コミュニケーションのあり方を変革する。

- Data: 非構造化情報からデータを生成・抽出・注釈し、研究データの網羅性と質を高める。

- Experiments: 実験のシミュレーションや計画支援によって研究の効率化を図る。

- Models: 複雑なシステムをモデリングし、従来の手法では扱えない依存関係や動態を捉える。

- Solutions: 膨大な探索空間から効率的に新しい解を導き出す。

出典:A New Golden Age of Discovery

なお同レポートには “AI scientists or AI-empowered scientists?” というセクションがあり、AIは科学者そのものになるのではなく、人間が不得手とする領域を担うことで科学者をエンパワーする存在になる、と述べています。これは本稿前セクションの「Co-scientist」の方向性と重なります。

DeepMindだけでなく、Microsoftは2022年に「AI for Science Lab」を設立し、著名な機械学習研究者Christopher Bishop氏を中心に、創薬、材料科学、気候科学などへの応用を進めています。さらに近年では、AI科学を専業とするスタートアップや非営利研究所も次々と立ち上がり、民間セクターを起点に新たな研究スタイルが形成されつつあります。

以上のように、政策においてもAI in/for Science「Next Big Thing(次なる重点施策)」であり、大手やスタートアップのAI企業もまた、AIによる科学応用に大きく乗り出しています。しかし、そこで念頭に置かれている「AI in/for Science」は、前セクションで述べたように極めて多様であり、どのような技術をどのように利用しようとしているのかについては、人によって大きく異なります。さらに気になるのは、前セクションで述べた「A. 科学的発見を行うコアプロセス」や「B. コアプロセス以外の広義の研究サイクル」に関する検討が多く、「C. 社会的な科学プロセス」における政策提言が少ないように見えることです。ここは「メタサイエンス」の視点が必要だと思われます。

生成AIを念頭に置いた各国の政策において共通して柱になりそうなのは、「研究のための計算資源の確保」「研究者に対するAIスキルの教育」「学際研究の促進」などです。さらに科学コミュニティの中で関心がどんどん高まっているのが、次のセクションの後半で扱うリスクの側面です。

3. AI in/for Scienceの光と闇

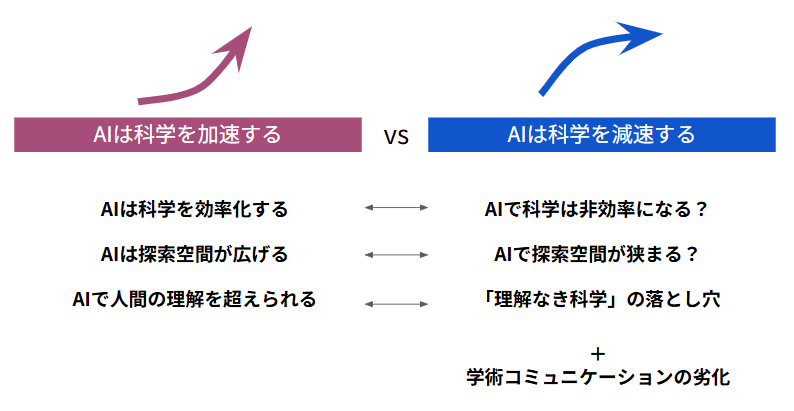

冒頭でも述べたように、AIの科学への導入については、ポジティブな面とネガティブな面が同時に語られています。

AIが科学にもたらすポジティブな効果

Anthropic CEO の Dario Amodei 氏は、2024年10月に公開したエッセイのなかで、AI の進展によって「20世紀に100年を要した科学の進歩が、今後は10年で達成できるようになる」と述べています。その見通しのもと、感染症やがんの根絶、寿命延長や遺伝子治療などの研究が大きく加速するだろうと予測しています。

では、なぜ AI は科学的発見を加速するのでしょうか。よく言われる要因として、次の3点を挙げることができます。

- AIによって科学は効率的になる

- AIによって人間の探索空間が広がる

- AIによって人間の理解を超えた理論・モデル構築が可能になる

第一の点は、AI が科学を効率化するというものです。実験でも計算でも、従来は人間が行っていた作業を AI やロボットが肩代わりすることで、科学研究は大幅に効率化すると期待されます。

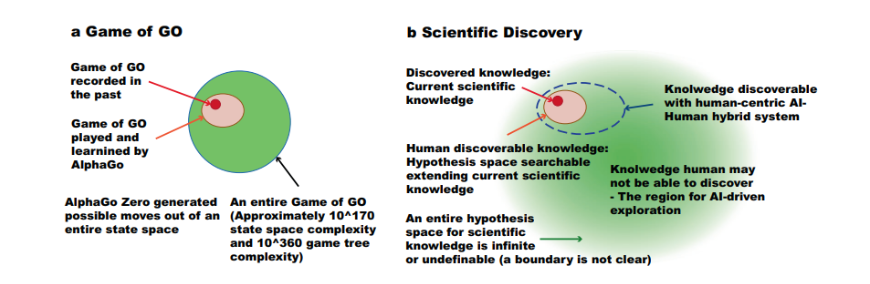

第二の点は、AI によって探索空間が広がることです。2016年に「ノーベル賞級の発見をAIが行うことを目指す」構想としてNobel Turing Challengeを提唱した北野宏明氏は、科学的発見の本質を大規模仮説空間の探索にあるとしています。その仮説空間はきわめて巨大であり、人間の直感や経験だけでは探索範囲が限られてしまいます。そこでAIを活用することで、人間が到達できない領域を探索し、新たな発見につなげることができると述べています。

出典:Kitano, H. Nobel Turing Challenge: creating the engine for scientific discovery. npj Syst Biol Appl 7, 29 (2021). https://doi.org/10.1038/s41540-021-00189-3

第三の点は、AI が人間の理解を超えた発見を可能にするというものです。人間の認知には限界があるため、私たちが理解できるのは低次元に縮約された説明にとどまります。しかしAIであれば、膨大な高次元データをそのまま扱うことができます。十分な量のデータがあれば、深層学習は任意の非線形・高次元関数を高い汎化性能で近似することが可能であり、「理解を介さずとも」精度の高い予測や制御を実現できる(「高次元科学」)という立場です。

この立場は、動物の脳のように極めて複雑な対象を扱う際に説得力を持ちます。2010年代には、深層ニューラルネットワーク(DNN)を脳の理論モデルとみなす神経科学研究が数多く登場しました。そこでは「DNN をどう解釈するか」という問題が生じますが、むしろ脳の振る舞いを再現するDNNを構築すること自体が研究目的でよいのではないか、という立場が提示されました。つまり、脳の振る舞いを写し取り、それを予測する高次元モデルを構築することを、複雑系である脳に対する「新しい理解の仕方」とみなす方向性です1。

AIが科学にもたらすリスク

一方で、科学に対する懸念もあります。

- AIによって科学は逆に非効率になる可能性がある

- AIによって探索空間が逆に狭まる

- AIによる「理解なき科学」の落とし穴

- AIによって学術コミュニケーションが劣化する

1〜3は、上記で挙げた3点の「ポジティブな効果」の裏返し、ないしは反論です。

第一に、AI やロボットを研究プロセスに導入することで、逆に非効率性が生まれる可能性があります。たとえば、合成生物学分野で AI・ロボット導入がどのような作業を発生させているかをエスノグラフィーの手法で調査した Ribeiro, B. ら(2023)2, “The digitalisation paradox of everyday scientific labour: How mundane knowledge work is amplified and diversified in the biosciences”, Research Policy, Vol. 52/1, p. 104607”)は、自動化とデジタル化が研究現場で進むなかで、データの確認・共有・標準化やロボットの整備といった「ありふれた知識労働(mundane knowledge work)」が増えていると報告しました。もっとも、これは第1セクションで述べたように「AI in/for Science」の多様な形態ごとに現れ方が異なる問題であり、ケースバイケースだと考えられます。

第二に、「AI だからこそより広く仮説空間を探索できる」という見方に反して、逆に探索が狭まるという議論もあります。人類学者と認知・神経科学者が AI 科学の問題を整理した Messeri & Crockett(2024)は、AI が必ずしも多様な立場を中立的に反映せず、特定の価値観や視野に基づいて研究を方向づけることで、科学が「モノカルチャー化」する危険を指摘しています3. ”)。

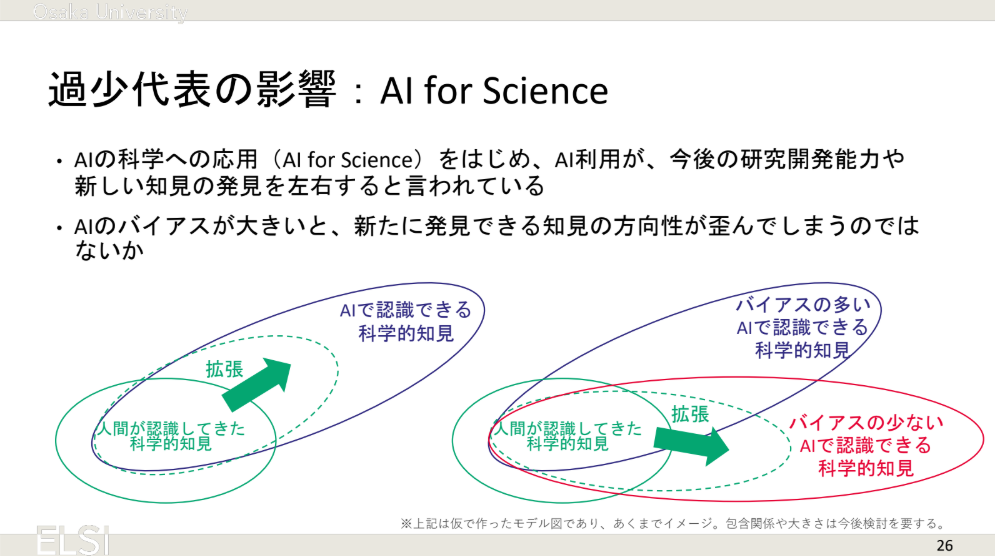

同様に、大阪大学の工藤郁子氏も、AI の持つバイアスがAI for Scienceにおける発見を特定の方向へと誘導してしまう可能性を指摘しています(下図)。

出典:工藤郁子氏資料「AI ガバナンスとフェアネス(2024年6月21日)20240621_ALIGN Webinar_工藤資料_ver2.pdf

第三に、「理解なき科学」への懸念があります。AI 研究の再現性などについて影響力のあるブログを執筆しているKapoor & Narayananは、エッセイ「Could AI slow science?」において、AI が科学を「減速」させる可能性を、科学計量学的なデータを交えつつ広範に考察しています。彼らは、理解を伴わずに解を生み出すだけの AI は、あたかもジムに行ってフォークリフトでダンベルを持ち上げるようなもので、科学的進歩に不可欠な要素を迂回してしまう危険があると指摘します。人間が理解できない高次元のモデルで現象の予測や制御ができたとしても、「次の問題を立てる」といった科学の発展性にとって人間の理解が不可欠ではないか、という指摘です。

こうした問題を回避するには、「AI 自身が科学を理解する」方向性が考えられるかもしれません。そこでは、「科学的理解とは何か」をめぐる哲学(”Understanding Scientific Understanding”)に立脚した検討が求められ、実際に「AIが科学的理解をもつとはどういうことか」についての科学哲学的な検討は始まっています。一方で、現今の生成 AI は何らかの意味で「理解」をしているとしても人間の理解とは質の異なる理解であり(cf. 「ポチョムキン理解」、人間とは異なる世界モデルを持つ可能性)、Kapoor らが指摘する問題はしばらくは解消されないと思われます。

最後に、AI 生成のアーティファクトが科学的な「ゴミ」を生み、科学の健全な発展を阻害するという問題があります。これは喫緊の課題として最も大きい懸念だと考えます。とりわけ、プレプリント・サーバーには AI が生成ないしアシストした質の低い投稿があふれており、2025年8月には代表的なプレプリント・サーバーの一つを運営する Center for Open Science が、質の低い投稿の大量流入を受けて generalist preprint server への新規投稿を一時停止すると発表しています。研究データのプラットフォーム「Figshare」を運営するMark Hahnel氏は、LLM が書いたプレプリントがレポジトリにあふれている状況に触れつつ、「サルにタイプライターを打たせてシェイクスピアが書けるか?」の現代版として、あてずっぽうのプロンプトで理論的発見を狙うような投稿が増えていると指摘しています。

もっとも、学術コミュニケーションの在り方そのものについては、AI 以前から限界が指摘されてきました。Arcadia Science や Astera Institute を率いる Seemay Chou 氏は、最近のエッセイのなかで、既存の学術出版が selective storytelling を蔓延させる構造的問題を抱えていると批判し、そこからの脱却を主張しています。そして AI を用いることで、より抜本的な変革が可能になるはずだとも述べています。すなわち、第1セクションで述べた「集団レベルの科学プロセス」の仕組みの見直しを、AI in/for Scienceは私たちに迫っていると言えます。

***

以上、きわめて足早ではありますが、昨今注目を集める「AI in/for Science」について、1)その形態の多様性、2)政策や民間企業からの注目、3)大きな可能性とその裏面・反論としてのリスク言説、について概観しました。転換期にある科学を見通し、「どんな科学をつくりたいか」を皆で議論を始める一つのプロンプトになれば幸いです。

「AIの科学研究への導入は、「科学的発見とは何か」、「科学的理解とは何か」、 「科学の価値とは何か」といった問題を改めて考え直す機会を提供する。」

「「AI時代の科学哲学」が、 いま求められているのである。」

——呉羽・久木田 2020「AIと科学研究」『人工知能と人間・社会』所収

謝辞:本メモ草稿にコメントをいただいた皆様に感謝申し上げます。

-

※現代の神経科学と「理解」の問題については、以下のような記事で考察しました。 ↩

-

Ribeiro, B. et al. (2023), “The digitalisation paradox of everyday scientific labour: How mundane knowledge work is amplified and diversified in the biosciences”, Research Policy, Vol. 52/1, p. 104607 ↩

-

Messeri, L., Crockett, M.J. Artificial intelligence and illusions of understanding in scientific research. Nature 627, 49–58 (2024). ↩